[ad_1]

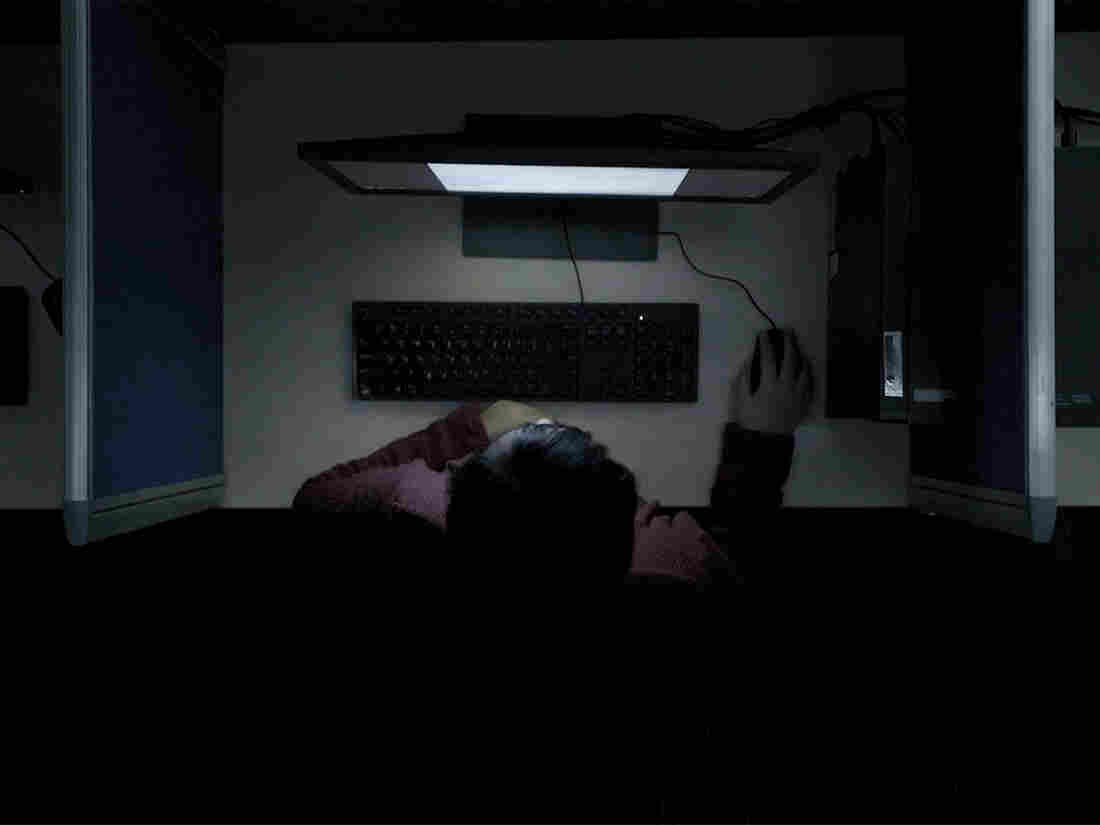

Les modérateurs de contenu sont responsables de déterminer ce que nous voyons et ce que nous ne faisons pas sur les médias sociaux.

Gracieuseté de gebrueder beetz filmproduktion

masquer la légende

activer la légende

Gracieuseté de gebrueder beetz filmproduktion

Les modérateurs de contenu sont responsables de déterminer ce que nous voyons et ce que nous ne faisons pas sur les médias sociaux.

Gracieuseté de gebrueder beetz filmproduktion

Des milliers de modérateurs de contenu travaillent sans relâche pour s'assurer que Facebook, YouTube, Google et d'autres plateformes en ligne restent libres de contenu toxique. Cela peut inclure la pêche à la traîne, les photos ou vidéos sexuellement explicites, les menaces de violence, etc.

Ces efforts – dirigés par des humains et des algorithmes – ont été vivement contestés ces dernières années. En avril, Mark Zuckerberg a expliqué devant un comité du Congrès comment Facebook travaillerait pour réduire la prévalence de la propagande, des discours de haine et d'autres contenus préjudiciables sur la plate-forme.

"D'ici la fin de l'année, plus de 20 000 personnes travailleront à la sécurité et à la révision du contenu", a déclaré Zuckerberg.

Les nettoyeurs, Un documentaire des réalisateurs Hans Block et Moritz Riesewieck cherche à faire la lumière sur la manière dont ce travail est effectué. Le film suit cinq modérateurs de contenu et dévoile leurs tâches.

"J'ai vu des centaines de décapitations. Parfois, ils ont de la chance parce que c'est une lame très tranchante à laquelle ils sont habitués", explique un modérateur du contenu dans un extrait du film.

Block et Riesewieck ont exploré de plus en plus les dures réalités associées au rôle de modérateur de contenu dans une interview avec Tout bien considéré.

Points saillants de l'entrevue

Journée typique d'un modérateur de contenu Facebook

Ils voient toutes ces choses que nous ne voulons pas voir en ligne, sur les médias sociaux. Cela pourrait être la terreur, cela pourrait être décapiter des vidéos comme celles dont la voix parlait avant. Il pourrait s'agir de pornographie, d'abus sexuel, de nécrophilie, d'une part.

D'autre part, il pourrait s'agir d'un contenu pouvant être utile pour des débats politiques, ou pour sensibiliser aux crimes de guerre, etc. Ils doivent donc modérer des milliers de photos tous les jours et faire vite pour atteindre le score de la journée. … C'est parfois autant de photos par jour. Et ensuite, ils doivent décider de le supprimer ou de le laisser rester en place.

Sur la décision de Facebook de supprimer la photo "napalm girl", lauréate du prix Pulitzer

Ce modérateur de contenu, il décide qu'il préférerait le supprimer, car il représente un jeune enfant nu. Il applique donc cette règle contre la nudité des enfants, qui est strictement interdite.

Il est donc toujours nécessaire de faire la distinction entre autant de cas différents. … Il reste tellement de zones grises dans lesquelles les modérateurs du contenu nous ont parfois dit qu'ils devaient décider par leur instinct.

Sur le poids de distinguer le contenu préjudiciable des images d'actualité ou de l'art

C'est un saut énorme – il est si complexe de faire la distinction entre ces différents types de règles. … Ces jeunes travailleurs philippins ont une formation de trois à cinq jours, ce qui ne suffit pas pour faire un travail comme celui-ci.

Sur l'impact quotidien des exposants sur les contenus toxiques

Beaucoup de jeunes sont extrêmement traumatisés par le travail.

Les symptômes sont très différents. Parfois, des gens nous ont dit avoir peur d'aller dans des lieux publics parce qu'ils observent des attaques terroristes tous les jours. Ou ils ont peur d'entretenir une relation intime avec son garçon ou sa petite amie parce qu'ils regardent des vidéos d'abus sexuel tous les jours. C'est donc un peu l'effet de ce travail a ….

Manille [capital of the Philippines] C’est un endroit où les déchets toxiques analogiques ont été envoyés du monde occidental, y sont envoyés depuis des années sur des porte-conteneurs. Et aujourd'hui, les déchets numériques y sont amenés. Maintenant, des milliers de jeunes modérateurs de contenu dans des tours de bureaux climatisées passent à travers l'infini mer toxique d'images et de tonnes de bêtises intellectuelles.

Emily Kopp et Art Silverman ont édité et produit cette histoire pour diffusion. Cameron Jenkins a produit cette histoire pour le numérique.

Source link